Коефіцієнт кореляції, його властивості

Зміст

| Поняття коваріації ………………………………………...... | |

| Коефіцієнт кореляції, його властивості …………………… | |

| Коефіцієнт кореляції Пірсона ………………………………. | |

| Список використаної літератури ………………………….. |

Поняття коваріації

Перевірка гіпотез про зв'язки, якщо мова йде про більш ніж однієї змінної, припускає одночасні зміни і вимірювання їх безвідносно до вказівкам спрямованості впливів (яка з змінних розглядається як впливає на іншу). Статистичної мірою зв'язку служить при цьому вибірковий коефіцієнт коваріації Sxy. Він підраховується як середнє добутків відхилень кожної змінної:

Sxy =

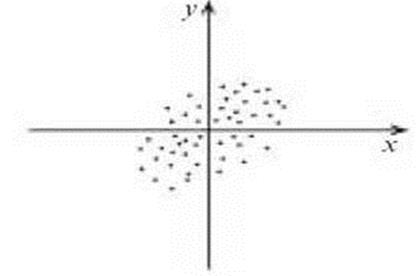

Саме коваріація характеризує зв'язок двох змінних Х і Y. Коваріація дає кількісну характеристику діаграми розсіювання, на якій змінні позначені осями, а окремі спостереження, тобто отримані емпіричні дані, - точками в прямокутній системі координат. Безліч точок утворює «хмару», за формою якого судять про зв'язок змінних Х і Y.

Якщо зв'язок позитивний, то більш високим значенням однієї змінної (X) частіше відповідають і більш високі значення іншої змінної (Y).

Коваріація дає кількісну характеристику діаграми розсіювання, на якій змінні позначені осями, а окремі спостереження, тобто отримані емпіричні дані, - точками в прямокутній системі координат. Безліч точок утворює «хмару», за формою якого судять про зв'язок змінних Х і Y.

Якщо зв'язок позитивний, то більш високим значенням однієї змінної (X) частіше відповідають і більш високі значення іншої змінної (Y). Цей випадок представлений на рис. 1. Чим більше за величиною коефіцієнт кореляції, тим більш витягнутим виглядає на діаграмі розсіювання це «хмару» даних.

Рис. 1. Діаграма розсіювання

Зауважимо, що коваріація змінної з самою собою - це дисперсія. При обговоренні трьох основних умов причинного виведення стосовно до експериментальних даних йдеться також про коваріацію незалежної і залежної змінних. Однак тут мається на увазі не випадковість характеру зв'язку між змінами цих змінних, а необхідність підрахунку коефіцієнту коваріації. Для кількісної оцінки експериментально отриманих ефектів зазвичай використовуються заходи відмінностей, а не заходи зв'язків.

Властивості коваріації вивчається у коваріаційному аналізі. Коваріаційний аналіз — це одночасний аналіз сум квадратів і сум добутків відхилень двох або більше змінних від їх середніх. Він використовується при плануванні і статистичній обробці результатів дослідів як спосіб зменшення помилки експерименту, яка не піддається безпосередньому контролю (вимірюванню). Коваріаційний аналіз дозволяє встановити співвідношення між варіацією залежної змінної у і варіацією незалежної х.

Коефіцієнт кореляції, його властивості

В теорії ймовірностей та математичній статистиці, кореляція є залежністю двох випадкових величин. При цьому, зміна однієї або кількох цих величин призводить до систематичної зміни іншої або інших величин. Математичною мірою кореляції двох випадкових величин слугує коефіцієнт кореляції.

Кореляція може бути позитивною та негативною (можлива також ситуація відсутності статистичного зв'язку - наприклад, для незалежних випадкових величин). Негативна кореляція - кореляція, при якій збільшення однієї змінної пов'язане зі зменшенням іншої, при цьому коефіцієнт кореляції від'ємний. Додатна кореляція - кореляція, при якій збільшення однієї змінної пов'язане зі збільшенням іншої, при цьому коефіцієнт кореляції додатній.

Коефіцієнт кореляції – показник, який використовують для вимірювання щільності зв'язку між результативними і факторними ознаками у кореляційно-регресійній моделі за лінійної залежності. За абсолютною величиною коефіцієнту кореляції коливається в межах від -1 до +1. Чим ближчий цей показник до 0, тим менший зв'язок, чим ближчий він до ±1 – тим зв'язок тісніший. Знак «плюс» при коефіцієнті кореляції означає прямий зв'язок між ознаками х і у, знак «мінус» – обернений.

Уперше коефіцієнт кореляції як показник щільності зв'язку використав К. Пірсон. Спочатку досліджувалася прямолінійна залежність, пов'язана із законом нормального розподілу (А. Браве, К. Пірсон, В. Шеппард та ін.), відтак виникла потреба в дослідженні й нелінійних залежностей. Для вимірювання щільності зв'язку нелінійних залежностей Пірсон запропонував кореляційне відношення із розробкою методів аналізу взаємозв'язку двох змінних було запропоновано теорію часткових і чистих коефіцієнтів кореляції, а також теорію множинної (багатофакторної) кореляції.

Коефіцієнт кореляції між досліджуваними ознаками повинен мати високий рівень достовірності (надійності). Для оцінки достовірності коефіцієнту кореляції обчислюють відношення коефіцієнта до його середньої помилки. Якщо воно дорівнює або більше 3, коефіцієнт кореляції вважають достовірним, тобто зв'язок між досліджуваними ознаками доведений. Якщо відношення менше 3, то не можна зробити висновку про достовірність зв'язку між досліджуваними ознаками. Для більшої надійності досліджень спід брати величину відношення коефіцієнту кореляції до його середньої помилки не 3, а 4. Якщо відношення коефіцієнту кореляції до його середньої помилки більше 3, а число спостережень більше 50, то вважають, що розрахований лінійний коефіцієнту кореляції відображає істотний тісний зв'язок.

Коефіцієнтом кореляції ρху випадкової величини (х,у), називають відношення

де σх, σу - середні квадратичні відхилення випадкових величин х та у.

Коефіцієнт кореляції незалежних випадкових величин дорівнює нулю. Випадкові величини, для яких кореляційний момент (а значить і коефіцієнт кореляції) дорівнює нулю, називають некорельованими. Очевидно, що для некорельованості випадкових величин достатньо, щоб їх сумісний розподіл був симетричний відносно будь-якої прямої, паралельної одній з осей координат.

Зауважимо, що рівність нулю коефіцієнта кореляції – необхідна, але не достатня умова незалежності випадкових величин.

Отже, з некорельованості випадкових величин не завжди випливає їх незалежність. Коефіцієнт кореляції характеризує не будь-яку залежність, а тільки так звану лінійну, яка полягає в тому, що при зростанні однієї з випадкових величин інша зростає (або спадає) за лінійним законом. Якщо випадкові величини х та у мають точно лінійну функціональну залежність х=aу+b , то ρху=±1 причому, якщо a>0 ρху=1 , а якщо a<0 ρху=-1. В загальному значення коефіцієнта кореляції ρху задовольняють нерівність: -1 ≤ ρху ≤ 1 .

Властивості коефіцієнта кореляції полягають в наступному:

1. Коефіцієнт кореляції є в межах від -1 до +1.

Якщо  (x, y) > 0, то кореляція пряма, а якщо

(x, y) > 0, то кореляція пряма, а якщо  (x, y) < 0 – зворотна. Пряма кореляція: більшим значенням випадкової змінної x відповідають більші значення y; зворотна кореляція: більшим значенням x відповідають менші y і навпаки, більшим y – менші x.

(x, y) < 0 – зворотна. Пряма кореляція: більшим значенням випадкової змінної x відповідають більші значення y; зворотна кореляція: більшим значенням x відповідають менші y і навпаки, більшим y – менші x.

2. Симетрія

(x, y) =

(x, y) =  (y, x)

(y, x)

3. Якщо x та y пов’язані лінійним функціональним зв’язком y(x) = a + bx, a і b – сталі, то  , і навпаки.

, і навпаки.

4. Якщо випадкові змінні лінійно незалежні, то  (x, y) = 0, і навпаки.

(x, y) = 0, і навпаки.

Останні дві властивості можна сформулювати як необхідну й достатню умови, причому критерієм залежності випадкових величин x і y є відмінність коефіцієнта кореляції від нуля:  .

.