История развития вычислительной техники

Определение информации.

Слово "информация" от informatio — сведение, разъяснение, ознакомление.

Информация— это совокупность каких-либо сведений, данных, передаваемых устно (в форме речи), письменно (в виде текста, таблиц, рисунков, чертежей, схем, условных обозначений) либо другим способом (например, с помощью звуковых или световых сигналов, электрических и нервных импульсов, перепадов давления или температуры и т. д.).

В середине XX века термин «информация» стал общенаучным понятием, включающим обмен сведениями между людьми, человеком и автоматом (электронной вычислительной машиной — ЭВМ), автоматом и автоматом, обмен сигналами в животном и растительном мире, передачу признаков от клетки к клетке, от организма к организму.

Теоретические и практические вопросы, относящиеся к информации, изучает информатика.

Информатика— наука, изучающая структуру и свойства информации, а также вопросы, связанные с ее сбором, хранением, поиском, передачей, преобразованием, распространением и использованием в различных сферах человеческой деятельности.

Еще одно определение информатики.

Информатика — это область человеческой деятельности, связанная с процессами преобразования информации с помощью компьютеров.

Дать однозначное определение информации трудно. Существует 4 подхода к определению информации:

- обыденный (в смысле осведомление о положении дел, это информация, сообщаемая по телефону, передаваемая по радио и телевидению),

- философский (информацию получает субъект об объекте в процессе познания; считается, что объект отражается в сознании субъекта),

- кибернетический (информация --- это управляющий сигнал, передаваемый по линии связи, однако это скорее носитель информации, чем сама информация),

- вероятностный (информация --- это мера уменьшения неопределенности состояния объекта исследования).

Поговорим подробнее о вероятностном подходе, так как он позволяет ввести количественную меру информации. Этот подход и принят за основу в современной науке.

Каждому объекту присуща какая либо неопределенность. Например, он может находиться в одном из нескольких фиксированных состояний. Упавшая монета находится в одном из двух состояний, игральный кубик — в одном из шести и т.д. В процессе испытания (бросание монеты, кубика) объект приобретает одно из возможных состояний. Следовательно, неопределенность состояния объекта при этом уменьшается. Тем самым испытатель получает какую-то информацию. Степень уменьшения неопределенности при испытании может быть разной. Она зависит от количества возможных состояний, и от их вероятностей.

Вероятность — это величина в диапазоне от 0 до 1, характеризующая частоту появления того или иного состояния объекта при испытаниях.

Понятно, что при выпадении наименее вероятного состояния получаем наибольшее количество информации. Если объект имеет n равновероятных состояний, то вероятность каждого из них равна 1/n. Например, вероятность выпадения одной из граней кубика при бросании равна 1/6, а вероятности выпадения орла (решки) при бросании монеты равна 0,5. Это означает, что из 1000 бросаний монеты реализуется примерно 500 выпадений орла (решки).

Пристальное внимание к информатике связано с бурным ростом объема человеческих знаний, который порой называют «информационным взрывом».Общая сумма человеческих знаний изменялась раньше очень медленно. Затем процесс получения новых знаний получил заметное ускорение. Так, общая сумма человеческих знаний к 1800 г. удваивалась каждые 50 лет, к 1950 г. — каждые 10 лет, а к 1970 г. — каждые 5 лет, к 1990 г. —ежегодно

Колоссальный объем информации передается по глобальной сети Интернет, которая связывает страны, расположенные на разных континентах.

Согласно отчету Computer Almanac Industry Inc., в 1998 г. во всем мире свыше 147 млн человек имели доступ к Интернету, по сравнению с 61 млн. в 1996 г. В отчете названы 15 наиболее «сетевых» стран мира.

Список возглавили США, где насчитывается 76,5 млн пользователей, затем следовали Япония и Великобритания с 9,75 млн и 8,1 млн пользователей соответственно. В десятке «сильнейших» оказались Германия — 7,14 млн пользователей, Канада— 6,49 млн, Австралия— 4,36 млн, Франция— 2,79 млн, Швеция— 2,58 млн, Италия 2,14 млн и Испания — 1,98 млн.

Оставшиеся пять стран в списке пятнадцати были: Нидерланды •— 1,96 млн пользователей Интернетом, Тайвань— 1,65 млн., Китай — 1,58 млн., Финляндия — 1,57 млн и Норвегия — 1,34 млн. Взятые вместе, эти 15 стран составляют 89% мирового «населения» Интернета.

Таким образом, в настоящее время накоплен большой объем информации, обработать который вручную людям невозможно (в силу своих психофизических особенностей).

Эффективным инструментом обработки большого объема информации является электронная вычислительная машина (ЭВМ).

Одним из основных факторов ускорения научно-технического прогресса является широкое использование новых информационных технологий,под которыми понимается совокупность методов и средствсбора, обработки и передачи данных (первичной информации) для получения информации нового качества о состоянии объекта, процесса или явления на базе вычислительной и коммуникационной техники и широкого применения математических методов.

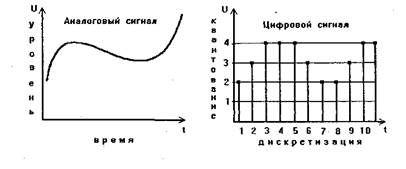

Различают две формы представления информации — непрерывную (аналоговую) и прерывистую (цифровую, дискретную).Непрерывная форма характеризует процесс, который не имеет перерывов и теоретически может изменяться в любой момент времени и на любую величину (например, речь человека, музыкальное произведение). Цифровой сигнал может изменяться лишь в определенные моменты времени и принимать лишь заранее обусловленные значения (например, только значения напряжений 0 и 3,5 В). Моменты возможного изменения уровня цифрового сигнала задает тактовый генератор конкретного цифрового устройства.

Для преобразования аналогового сигнала в цифровой сигнал требуется провести дискретизацию непрерывного сигнала во времени, квантование по уровню, а затем кодирование отобранных значений.

Дискретизация— замена непрерывного (аналогового) сигнала последовательностью отдельных во времени отсчетов этого сигнала. Наиболее распространена равномерная дискретизация, в основе которой лежит теорема Котельникова.

На рисунке схематично показан процесс преобразования аналогового сигнала в цифровой сигнал. Цифровой сигнал в данном случае может принимать лишь пять различных уровней. Естественно, что качество такого преобразования невысокое. Из рисунка видно, что изменение цифрового сигнала возможно лишь в некоторые моменты времени (в данном случае этих моментов одиннадцать).

После такого преобразования непрерывный сигнал представляют последовательностью чисел. Показанный на рисунке непрерывный сигнал заменяется числами 2-3-4-4-4-3-2-2-3-4-4. Затем перечисленные десятичные числа преобразуют (кодируют) в последовательность единиц и нулей. Результаты данного преобразования можно представить таблицей:

После такого преобразования непрерывный сигнал представляют последовательностью чисел. Показанный на рисунке непрерывный сигнал заменяется числами 2-3-4-4-4-3-2-2-3-4-4. Затем перечисленные десятичные числа преобразуют (кодируют) в последовательность единиц и нулей.

Первое представление об аналоговом и цифровом способах хранения и распространения информации можно получить, рассматривая два способа записи звуковых сигналов: аналоговую и цифровую аудиозаписи.

При аналоговой аудиозаписи непрерывный электрический сигнал, формируемый источником звука на выходе микрофона, с помощью магнитной головки наносится на движущуюся магнитную ленту. Недостатком аналогового способа обработки информации является то, что копия бывает всегда хуже оригинала.

При цифровой аудиозаписи используется процесс выборки, заключающийся в периодическом измерении уровня (громкости) аналогового звукового сигнала (например, поступающего с выхода микрофона) и превращении полученного значения в последовательность двоичных чисел. Для преобразования аналогового сигнала в цифровой используется специальный конвертор, называемый аналогово-цифровой преобразователь (АЦП). Сигнал на выходе АЦП представляет собой последовательность двоичных чисел, которая может быть записана на лазерный диск или обработана компьютером. Обратная конверсия цифрового сигнала в непрерывный сигнал осуществляется с помощью цифроаналогового преобразователя (ЦАП).

Качество аналогово-цифрового преобразования характеризует параметр, называемый разрешением. Разрешение— это количество уровней квантования, используемых для замены непрерывного аналогового сигнала цифровым сигналом. Восьмиразрядная выборка позволяет получить только 256 различных уровней квантования цифрового сигнала, а шестнадцатиразрядная выборка — 65 536 уровней.

Еще один показатель качества трансформации непрерывного сигнала в цифровой сигнал — это частота дискретизации — количество преобразований аналог-цифра (выборок), производимое устройством в одну секунду.

Этот показатель измеряют килогерцами (килогерц — тысяча выборок в секунду). Типичное значение частоты дискретизации современных лазерных аудиодисков — 44,1 кГц.

Имеется тенденция перехода к единому цифровому представлению всех видов информации. Глобальная сеть Интернет претендует на то, чтобы объединить все средства вещания и коммуникации, компьютерные, телефонные, радио- и видеосети, связав их в единое «киберпространство».

Информационные процессы.

Каждый из нас слышал, что информацию можно собирать, хранить, передавать, обрабатывать и использовать. Наглядный пример информационной системы — зрение. Глаз собирает информацию. В нервной ткани глаза информация сложным образом преобразуется и передается в зрительные отделы головного мозга. Здесь она подвергается дальнейшей обработке и результат обработки немедленно используется: к нашим мышца поступают сигналы – информация.

Другой пример — система терморегуляции человека. Наша кожа содержит много клеток-датчиков.

— Продолжите рассказ об этой информационной системе.

Мы записывали определение информатики в тетрадь. Эта процедура включает несколько этапов.

· Кодирование. Лектор выразил хранящееся в памяти определение с помощью слов.

- Передача. С помощью колебаний воздуха и световых волн он передал сообщение.

- Накопление. Студенты записали в тетрадь.

- Обработка. Расставили необходимые знаки препинания.

Заметим, что информация не может существовать без физического носителя (мозг, звук, бумага).

Рассмотрим теперь каждый процесс в отдельности.

Кодирование — это представление информации в виде какой-либо последовательности сигналов. Любая работа с информацией требует ее кодирования. Одну и ту же информацию можно кодировать по-разному. Кодирование сигнала СОС может быть таким SOS или таким — · —. Один из наиболее простых и надежных способов — двоичное кодирование. При этом используются всего два сигнала. Пример — азбука Морзе.

Передача информации осуществляется по каналам связи с помощью каких-либо носителей. Например, человеческая речь распространяется в воздухе с помощью звуковых волн, информация от телецентра распространяется тоже в воздухе (хотя может распространяться и в вакууме) с помощью электромагнитных волн и д.т. В любом реальном канале связи обязательно присутствует шум — мешающее воздействие.

Для накопления информации используют долговременные носители: скалы (наскальные рисунки — хоть и примитивное, но накопление информации), книги (и бумага вообще), виниловые пластинки для накопления звуковой информации, магнитная лента, магнитные диски (гибкие и жёсткие), CD диски.

Обработка — это внесение изменений в имеющуюся информацию (выполнение арифметических действий, исправление ошибок в сочинении, оформление результатов лабораторного опыта и т.д.)

Количество информации.

С позиции каждого отдельного человека количество информации, содержащееся в каком-либо сообщении, — субъективная величина.

Объективная количественная мера информации может быть введена на основе вероятностной трактовки информационного обмена.

Этот способ измерения количества информации впервые предложил в 1948 г. К. Шеннон.По К. Шеннону, информация— это сведения, уменьшающие неопределенность (энтропию), существовавшую до их получения.

Количественное описание информации базируется на вероятностном подходе. За единицу информации принимается один бит. Это такое количество информации, получаем в результате реализации одного из двух равновероятных событий, например, при бросании монеты. Термин "бит" произошел от выражения binary digit, что означает "двоичная цифра", то есть принимающая значение 0 или 1.

Один бит информации получает человек, когда он узнает опаздывает с прибытием нужный ему поезд или нет, был ночью мороз или нет, присутсву-ет на лекции студент Иванов или нет и т. д.

Таким образом, применительно к ЭВМ на одном проводе можно реализовать два взаимоисключающих события: есть напряжение и нет напряжения. Следовательно, одним проводом можно передать 1 бит информации.

Более крупная единица информации — байт— равна 8 бит. Проверка присутствия или отсутствия на лекции 24 студентов дает лектору три байта информации. Еще более крупная единица информации — 1 Кбайт — равна 1024 байтам. Далее— 1 Мбайт равен 1024 Кбайтам, 1 Гбайт равен 1024 Мбайтам, а 1 Тбайт равен 1024 Гбайтам.

Для измерения больших объемов информации применяют кратные единици информации:

1 байт = 8 бит;

1 килобайт (Кб) = 1024 байт;

1 Мегабайт (Мб) = 1024 Кб = 1048576 байт;

1 Гигабайт (Гб) = 1024 Мб = 1048576 Кб.

§2. История развития ЭВМ. Поколения ЭВМ. (Лекция 2)

Связь информации и ЭВМ.

В самом начале лекции стоит провести настойчивую мысль о том, что ЭВМ — это устройство, которое призвано помочь человеку в выполнении рутинной работы. Это всего-навсего инструмент в руках человека, такой же, как калькулятор, станок и т. д. Но пользоваться этим инструментом необходимо уметь. Для этого мы изучаем его в курсе информатики. С помощью ЭВМ можно эффективно обрабатывать большие объемы информации. В связи с этим появляется необходимость изучить само понятие информации. Поэтому-то изучение ЭВМ и понятия информации объединяют в единые предмет "информатика".

История развития вычислительной техники.

Основные этапы развития вычислительной техники представлены в таблице.

| Этап Период развития Ручной не установлен Механический с середины XVII в Электромеханический с 90-х годов XIX в Электронный с 40-х годов XX в |

Рассмотрим основные моменты каждого этапа.

Более трех тысяч лет назад в Средиземноморье было распространено простейшее приспособление для счета: доска, разделенная на полосы, где перемещались камешки или кости. Такая счетная дощечка называлась абаки использовалась для ручного счета. В Древнем Риме абак назывался calculi или abaculi и изготавливался из бронзы, камня, слоновой кости и цветного стекла. Слово calculus означает «галька», «голыш». От этого слова произошло латинское слово calculatore (вычислять), а затем слово «калькуляция». Абак позволял лишь запоминать результат, а все арифметические действия должен был выполнять человек.

Первая механическая машина была построена немецким ученым Вильгельмом Шиккардом(предположительно в 1623 г.). Машина была реализована в единственном экземпляре и предназначалась для выполнения арифметических операций. Из-за недостаточной известности машины Шиккарда более 300 лет  считалось, что первую суммирующую машину сконструировал Блез Паскаль.

считалось, что первую суммирующую машину сконструировал Блез Паскаль.

Блез Паскаль(французский математик, физик, религиозный философ и писатель) в 1642 г. изобрел механическую счетную машину, выполнявшую сложение, а в 1674 г. Готфрид Лейбницрасширил возможности машины Паскаля, добавив операции умножения, деления и извлечения квадратного корня. Специально для своей машины Лейбниц применил систему счисления, использующую вместо привычных для человека десяти цифр две: 1 и 0. Двоичная система счислений широко используется в современных ЭВМ.

Ни одна из этих машин не была автоматической и требовали непрерывного вмешательства человека. В 1834 г. Чарлз Бэббидж(Charles Babbage) первым разработал подробный проект автоматической вычислительной машины. Он так и не построил свою машину, так как в то время невозможно было достичь требуемой точности изготовления ее узлов.

Ч. Бэббидж выделял в своей машине следующие составные части:

• «склад» для хранения чисел (по современной терминологии память);

• «мельницу» для производства арифметических действий (арифметическое устройство, процессор);

• устройство, управляющее последовательностью выполнения операций (устройство управления);

• устройства ввода и вывода данных.

В качестве источника энергии для приведения в действие механизмов машины Ч. Бэббидж предполагал использовать паровой двигатель.

Бэббидж предложил управлять своей машиной с помощью перфорированных карт, содержащих коды команд, подобно тому как использовались перфокарты в ткацких станках Жаккара.На этих картах было представлено то, что сегодня мы назвали бы программой.

Ч. Бэббидж довольно подробно рассматривал вопросы, связанные, как мы сейчас говорим, с программированием. В частности, им была разработана весьма важная для программирования идея «условной передачи управления». Идеи Бэббиджа заложили фундамент, на котором со временем были построены ЭВМ.

Первые программы для вычислительной машины Бэббиджа создавала Ада Лав-лейс(Ada Lovelace) — дочь известного поэта

Джорджа Байрона, в честь которой впоследствии был назван один из языков программирования. Выражаясь современным языком, Лавлейс составила программу вычисления' чисел Бернулли. Ада Лавлейс разработала основные принципы программирования, которые остаются актуальными до настоящего момента времени. Ряд терминов, введенных Адой Лавлейс, используются и сейчас, например, «цикл», «рабочие ячейки».

Теоретические основы современных цифровых вычислительных машин заложил английский математик Джордж Буль(1815—1864). Он разработал алгебру логики, ввел в обиход логические операторы И, ИЛИ и НЕ. Заметим, что его дочь Э. Войнич — автор известного произведения «Овод».

В 1888 г. Германом Холлеритом(Herman Hollerith) была сконструирована первая электромеханическая машина для сортировки и подсчета перфокарт. Эта машина, названная табулятором,содержала реле, счетчики, сортировочный ящик. Изобретение Холлерита было использовано при подведении итогов переписи населения в США.

Успех вычислительных машин с перфокартами был феноменален. То, чем за десять лет до этого занимались 500 сотрудников в течение семи лет, Холлерит сделал с 43 помощниками на 43 вычислительных машинах за 4 недели.

В 1896 г. Герман Холлерит основал фирму Computing Tabulation Company. Спустя несколько лет это предприятие переименовали в известнейшую теперь фирму International Business Machine Corporation (IBM).

Немецкий инженер Конрад Цузе(Konrad Zuse) был первым, кто успешно осуществил идею создания автоматической электромеханической вычислительной машины на основе двоичной системы счисления. В 1936 г. он начал конструировать вычислительный аппарат, работающий в двоичной системе счисления, который впоследствии был назван Zuse I(Z1).

В 1941 г. Цузе сумел построить действующую модель Zuse 3, которая состояла из 600 реле счетного устройства и 2000 реле устройства памяти.

В 1944 г. (по другим источникам, в 1943 г.) в Англии было разработано полностью автоматическое вычислительное устройство Colossus II. Основным его назначением была дешифровка перехваченных сообщений военного противника.

Еще одна полностью автоматическая вычислительная машина, изобретенная профессором Гарвардского университета Говардом Айкеном(Aiken Howard, 1900—1973), при участии группы инженеров фирмы IBM, была построена в 1944 г. Она была названа ASCC(другое название Mark1) и была электромеханической (построена на реле), состоящей приблизительно из 750 тысяч компонентов. На умножение она тратила около 4 секунд. До знакомства с работами Цузе научная общественность считала машину ASCC первой электромеханической машиной.

В 1937 г. в США Дж. Атанасовначал работы по созданию электронной вычислительной машины. Им были созданы и запатентованы первые электронные схемы отдельных узлов ЭВМ. Совместно с К. Берри к 1942 г. была построена электронная машина ABC (Atanasoff-Berry Computer).

Электроннаявычислительная машина, разработанная Эккертом и Маучли(John W. Mauchly and J. Presper Eckert, Jr.) в США в 1946 г., была названа ENIAC. При создании этой машины Эккерт и Маучли заимствовали основные идеи у Дж. Атанасова. ENIAC была примерно в 1000 раз быстрее, чем ASCC. Она состояла из 18 тысяч электронных ламп, 1,5 тысячи реле, имела вес более 30 тонн, потребляла мощность более 150 кВт.

Первоначально ENIAC программировалась путем соединения проводами соответствующих гнезд на коммутационной панели, что делало составление программы очень медленным и утомительным занятием. Американский математик и физик венгерского происхождения Джон фон Нейман(1903—1957) предложил хранить программу — последовательность команд управления ЭВМ— в памяти ЭВМ, что позволяло опе рировать с программой так же, как с данными.

Последующие ЭВМ строились с большим объемом памяти, с учетом того, что там будет храниться программа.

В докладе фон Неймана, посвященном описанию ЭВМ, выделено пять базовых элементов компьютера:

• арифметико-логическое устрой-

ство (АЛУ);

• устройство управления (УУ);

• запоминающее устройство (ЗУ);

• система ввода информации;

• система вывода информации.

Описанную структуру ЭВМ принято называть архитектурой фон Неймана.

Поколения ЭВМ.

ЭВМ первого поколенияв качестве элементной базы использовали электронные лампы и реле.

Первое: элементарная база — лампы, оперативная память на электронно-лучевых трубках и ферритовых сердечниках, быстродействие до 20000 оп/сек., охлаждение, однопрограммность.

Изобретение в 1948 г. транзисторов и запоминающих устройств на магнитных сердечниках оказало глубокое воздействие на вычислительную технику. Ненадежные вакуумные лампы, которые требовали большой мощности для нагревания катода, заменялись небольшими германиевыми (впоследствии кремниевыми) транзисторами. Компьютеры, построенные в середине 50-х годов XX в., стали называть машинами второго поколения.

Второе: 60 гг, элементарная база — полупроводниковые транзисторы, быстродействие 104–105 оп/сек. Объем памяти — до 150 слов при длине слова до 50 двоичных разрядов. Программирование велось на алгоритмических языках Фортран, Алгол, Кобол.

Революционный прорыв в миниатюризации и повышении надежности компьютеров произошел в 1958 г., когда американский инженер Д. Килби (Jack Kilby) разработал первую интегральную микросхему. В середине 60-х годов появилось третье поколениеЭВМ, основу элементной базы которых составляли микросхемы малой и средней степени интеграции.

Третье: элементарная база — интегральные схемы (ИС), быстродействие 106–107 оп/сек. Резко снижены габариты и энергопотребление ЭВМ. Оперативная память строилась на ИС и достигала объема 105–106 байт. Унифицировались периферийные устройства. Появился широкий выбор языков программирования. Стали использоваться операционные системы, позволяющие резко повысить производительность и организовать многопрограммный и терминальный режимы.

Другая революция в технологии изготовления ЭВМ произошла в 1971 г., когда американский инженер Маршиан Эдвард Хофф (Marcian Е. Hoft) объединил основные элементы компьютера в один небольшой кремниевый чип (кристалл), который он назвал микропроцессором.Первый микропроцессор получил маркировку Intel 4004.

ЭВМ четвертого поколениястроятся на интегральных микросхемах с большой степенью интеграции. На одном кристалле размещается целая микроЭВМ. Заметим, что переход от третьего поколения ЭВМ к четвертому не был революционным. Отличия коснулись не столько принципов построения ЭВМ, сколько плотности упаковки элементов в микросхемах.

Четвертое: элементарная база — большие и сверхбольшие ИС (БИС и СБИС). Быстродействие 107–108 оп/сек. Формируются два направления — многопроцессорные и персональные ЭВМ. Появляются компьютерные сети. Разрабатывается специализированное программное обеспечение, позволяющее оперативно программировать решение задач определенного класса (например, в таких областях как статистика, инженерная графика, научно-технические расчеты и т.д.).

Развитие ЭВМ идет по пути непрерывного повышения быстродействия, надежности, расширения функциональных возможностей, уменьшения габаритов и потребляемой мощности, упрощения правил работы на компьютере. Среди ЭВМ четвертого поколения появились персональные компьютеры (ПК или ПЭВМ), которые позволяют индивидуально работать каждому пользователю.

Первой ПЭВМ можно считать компьютер Altair-8800, созданный в 1974 г. Э. Робертсом.Для этого компьютера П. Аллен и Б. Гейтсв 1975 г. создали транслятор с популярного языка Basic. Впоследствии П. Аллен и Б. Гейтс создали известную компанию Microsoft.

В 1976 г. Стивен П. Джобе и Стефан Г. Возниакосновали в гараже Пало-Алъто (Калифорния) предприятие Apple Computer. После шести месяцев работы Возниаку удалось собрать действующий макет под названием Apple 1. В настоящее время компания с таким названием хорошо известна многим пользователям ЭВМ.

В настоящее время ведется разработка ЭВМ пятого поколения,характерными особенностями которых будут способность к самообучению и наличие речевого ввода и вывода информации.

Таким образом, вычислительная техника постоянно впитывала в себя самые последние достижения науки, техники и технологии (электронные лампы, транзисторы, микроэлектроника, лазеры, средства связи), благодаря чему ее развитие идет необычайно высокими темпами.

В следующем столетии, когда на смену электронным приборам придут квантовые, оптические или биоэлектронные приборы, то современные нам ЭВМ будут казаться будущим пользователям такими же монстрами, какими нам кажутся вычислительные машины 40-х годов XX в.